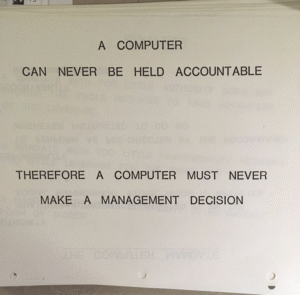

Vous l’avez peut-être vue passer. Une vieille feuille jaunie, une police de machine à écrire, et cette phrase qui claque comme un avertissement :

Pendant longtemps, le débat s’est focalisé sur l’authenticité du document (spoiler : c’est bien un héritage d’IBM). Mais honnêtement, on se moque de savoir si le papier date de 1979. Ce qui compte, c’est la violence de sa pertinence en 2025.

À l’époque, on parlait de mainframes. Aujourd’hui, la tentation est immense de laisser des modèles génératifs prendre le volant. C’est là que le danger change de nature : il n’est plus seulement technique, il devient stratégique et juridique.

Ce que je transmets en formation : 3 règles pour rester aux commandes

Mon métier n’est pas de former des techniciens du code, mais des professionnels éclairés. Dans mes sessions, nous sortons du fantasme pour revenir au terrain. Voici les 3 piliers que nous travaillons pour que l’IA reste un levier, et non un risque.

1. L’IA propose, le pro dispose (cf. l’épreuve de l’Appel d’Offres)

L’illusion la plus dangereuse est de croire qu’on peut automatiser la stratégie. Prenons un cas que nous traitons souvent : la réponse aux appels d’offres.

Oui, l’IA peut pré-rédiger, structurer, synthétiser des kilomètres de documents techniques. C’est un gain de temps phénoménal. Mais croire qu’on peut appuyer sur un bouton et envoyer le dossier est suicidaire. La décision de Go / No Go (y va-t-on ou pas ?) et la validation des formulations clés (celles qui vous engagent juridiquement ou commercialement) doivent impérativement rester entre les mains de personnes d’expérience. L’IA n’a pas votre intuition politique ni votre connaissance de l’historique client.

2. La ligne rouge réglementaire (l’exemple du recrutement)

« L’IA est objective, laissons-la trier. » C’est le piège classique. Dans le recrutement, passer en revue des centaines de CV est laborieux, ingrat, répétitif. La tentation de l’automatisation totale est forte.

Pourtant, c’est à vous de le faire, pas à une IA en mode pilote automatique. Pourquoi ? Parce que déléguer le tri des humains à une machine est désormais une zone critique. L’AI Act européen est très clair là-dessus : le tri automatique de CV est classé comme une activité à Haut Risque. En formation, j’insiste là-dessus : utiliser l’IA pour résumer ou extraire des compétences, oui. Lui laisser la responsabilité du filtre final, c’est s’exposer à des biais massifs et à des sanctions réelles.

3. L’IA comme « sparring partner »

Une fois ces gardes-fous posés, on peut (enfin) s’amuser. Car l’IA est redoutable quand elle est utilisée non pas comme un décideur, mais comme un partenaire de réflexion.

C’est là que l’outil devient puissant : pour tester ses idées, pour challenger un argumentaire, pour trouver la faille dans un raisonnement. C’est un miroir intelligent. En session, nous l’utilisons pour simuler des objections ou affiner des stratégies. L’IA ne remplace pas votre réflexion, elle la muscle.

Apprendre à pêcher, plutôt que donner du poisson

La phrase de 1979 n’a pas pris une ride, mais la conclusion, elle, doit évoluer. L’enjeu n’est pas d’avoir peur de la machine, ni de lui vouer un culte.

Mon objectif, que ce soit avec des cadres dirigeants ou des équipes opérationnelles, est le même : vous rendre autonomes. Comprendre comment fonctionne le modèle, savoir où il excelle et où il hallucine, c’est la seule manière de garder la main. Je ne suis pas là pour vous donner des « prompts magiques » qui feront le travail à votre place, mais pour vous apprendre à maîtriser l’outil pour qu’il serve votre expertise.

Parce qu’au final, la seule intelligence qui sera tenue pour responsable, c’est la vôtre.